Introdução2.1

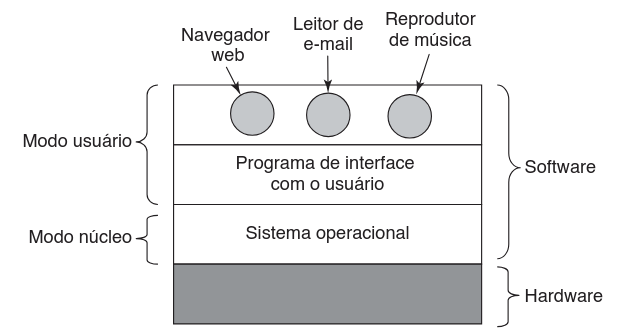

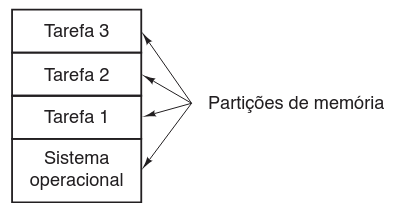

O sistema operacional atua como uma camada de software vital que interpõe o hardware físico e os programas aplicativos. Sua função primordial é abstrair a complexidade dos componentes eletrônicos, oferecendo um modelo de máquina mais simples e gerenciável para os programadores e usuários, além de controlar o alocamento de recursos do sistema. A posição hierárquica do sistema operacional pode ser visualizada na figura abaixo:

Para garantir a estabilidade e a segurança, os computadores operam distinguindo dois níveis de privilégio. O Modo Núcleo (Kernel) é exclusivo do sistema operacional e permite acesso irrestrito a todo o hardware e instruções da máquina. Em contrapartida, o Modo Usuário é onde residem os aplicativos comuns (como navegadores e editores), que possuem acesso limitado e dependem do núcleo para realizar operações críticas de entrada e saída.

É fundamental compreender que a interface gráfica (GUI) ou a linha de comando (Shell) com a qual o usuário interage não constitui o sistema operacional em si. Elas são apenas programas de modo usuário que servem de ponte para as funcionalidades do núcleo.

Devido à sua imensa complexidade e tamanho, que frequentemente alcança milhões de linhas de código, os sistemas operacionais tendem a ter uma vida longa e evoluem gradualmente ao longo do tempo, em vez de serem reescritos do zero. A tabela a seguir sintetiza os conceitos centrais abordados:

| Conceito | Característica Principal |

|---|---|

| Abstração | Transforma hardware complexo em interfaces de programação limpas. |

| Modo Núcleo | Acesso total ao hardware, protegido contra modificações do usuário. |

| Modo Usuário | Ambiente restrito para execução de softwares aplicativos. |

| Evolução | Softwares de longa duração que evoluem incrementalmente (ex: Windows, UNIX). |

O SO como uma máquina estendida2.2

Definir com precisão absoluta o que é um sistema operacional é uma tarefa complexa, pois ele vai além de ser apenas o software que opera em modo núcleo. A dificuldade reside no fato de que os sistemas operacionais desempenham duas funções essenciais, porém distintas: fornecer aos programadores um conjunto de recursos abstratos e limpos, em substituição aos recursos complexos do hardware, e gerenciar esses mesmos recursos físicos. Dependendo do foco da análise, uma função pode ser mais enfatizada que a outra.

Ao analisarmos o sistema operacional como uma máquina estendida, percebemos que a arquitetura da maioria dos computadores, em nível de linguagem de máquina, é primitiva e de difícil programação, especialmente no que tange à entrada e saída (E/S). Um exemplo claro dessa complexidade são os discos rígidos modernos SATA. A documentação técnica necessária para um programador utilizar diretamente uma versão inicial dessa interface ultrapassava 450 páginas, e a complexidade só aumentou com o tempo. Como é inviável para um programador lidar com esses detalhes físicos, utiliza-se um software chamado driver de disco para intermediar a comunicação com o hardware.

No entanto, mesmo o nível dos drivers pode ser baixo demais para a maioria das aplicações. Por essa razão, os sistemas operacionais introduzem uma abstração fundamental: o arquivo. Graças a essa abstração, programas podem criar, ler e escrever dados sem a necessidade de compreender o funcionamento mecânico e eletrônico dos discos. Boas abstrações têm o poder de transformar tarefas quase impossíveis em atividades gerenciáveis, convertendo a complexidade do hardware em conceitos compreensíveis, como fotos, e-mails ou páginas da web.

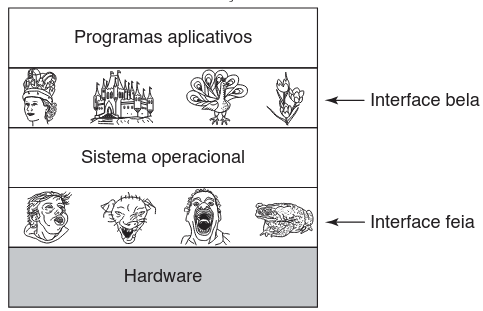

A função primordial do sistema operacional é, portanto, ocultar o "hardware feio", com suas interfaces idiossincráticas e inconsistentes, e apresentar aos programas abstrações "belas", limpas e elegantes. A figura a seguir ilustra essa transformação:

Projetistas de hardware frequentemente priorizam economia ou compatibilidade legada, o que resulta em interfaces complicadas para o desenvolvimento de software. O sistema operacional atua como um "embelezador", transformando interfaces de hardware desajeitadas em interfaces de programação lógicas e consistentes.

É crucial observar que os verdadeiros "clientes" do sistema operacional são os programas aplicativos. São eles que interagem diretamente com as abstrações fornecidas. Embora as interfaces com o usuário (como a área de trabalho do Windows ou o shell do Linux) utilizem essas abstrações, elas são distintas do sistema operacional em si. Diferentes interfaces, como Gnome ou KDE no Linux, podem apresentar visuais completamente distintos, mas baseiam-se nas mesmas abstrações do sistema operacional subjacente.

Para consolidar o entendimento sobre a função de abstração, observe a tabela comparativa abaixo:

| Nível | Característica | Exemplo Prático |

|---|---|---|

| Hardware (Realidade) | Complexo, primitivo, interfaces difíceis e inconsistentes. | Controladora de disco SATA, setores, trilhas, cabeçotes. |

| Sistema Operacional (Abstração) | Limpo, elegante, consistente e fácil de programar. | Arquivos, pastas, fluxos de dados. |

| Resultado | Transforma o impossível em gerenciável. | Salvar uma foto sem precisar posicionar o cabeçote do disco. |

O SO como gerenciador de recursos2.3

A compreensão de um sistema operacional pode ser abordada sob duas perspectivas distintas. Enquanto a visão top-down (de cima para baixo) foca na abstração fornecida aos aplicativos, a visão alternativa bottom-up (de baixo para cima) sustenta que o sistema operacional existe fundamentalmente para gerenciar todas as partes de um sistema complexo. Computadores modernos são compostos por processadores, memórias, temporizadores, discos, interfaces de rede e uma vasta gama de dispositivos de entrada e saída. Sob esta ótica, a função primordial do sistema é fornecer uma alocação ordenada e controlada desses componentes entre os diversos programas que competem por eles.

Imagine a consequência de três programas tentando imprimir saídas simultaneamente na mesma impressora. Sem gerenciamento, as linhas do programa 1 se misturariam com as do programa 2 e do programa 3, resultando em um documento incompreensível. O sistema operacional evita esse caos absoluto ao armazenar temporariamente os dados em disco, organizando a fila de impressão e garantindo que cada documento seja impresso integralmente antes do próximo.

Em ambientes com múltiplos usuários ou redes, a necessidade de gerenciamento torna-se ainda mais crítica. É necessário proteger a memória e os dispositivos de E/S para evitar que usuários interfiram uns com os outros, além de facilitar o compartilhamento seguro de informações como arquivos e bancos de dados. Em suma, o sistema operacional atua como um mediador que contabiliza o uso, concede recursos e resolve requisições conflitantes.

Esse gerenciamento é realizado através da multiplexação, que pode ocorrer de duas formas distintas, detalhadas na tabela a seguir:

| Tipo de Multiplexação | Definição | Exemplo Prático |

|---|---|---|

| No Tempo | Diferentes programas ou usuários se revezam no uso do recurso sequencialmente. O SO decide quem é o próximo e por quanto tempo. | CPU: Um programa usa o processador, depois cede lugar a outro. Impressora: Impressão de um arquivo completo por vez. |

| No Espaço | O recurso é dividido fisicamente, permitindo que múltiplos clientes tenham sua própria "fatia" simultaneamente. | Memória: Dividida entre vários programas residentes ao mesmo tempo. Disco: Blocos alocados para arquivos de diferentes usuários simultaneamente. |

A multiplexação de espaço, embora eficiente, levanta questões sobre justiça e proteção que o sistema operacional deve solucionar. É mais eficiente manter vários programas carregados parcialmente na memória do que dedicar toda a memória a um único programa que utilizaria apenas uma fração dela.

História dos sistemas operacionais2.4

A trajetória dos sistemas operacionais está intrinsecamente vinculada à evolução da arquitetura dos computadores. Embora essa correlação cronológica apresente imprecisões, sobreposições e desenvolvimentos paralelos, analisar as sucessivas gerações de hardware oferece uma estrutura lógica fundamental para compreender o progresso do software de sistema.

O marco inicial remonta ao matemático inglês Charles Babbage (1792–1871), que projetou o primeiro computador verdadeiramente digital, denominado "máquina analítica". Tratava-se de um dispositivo puramente mecânico que nunca funcionou plenamente, pois a tecnologia de fabricação da época não conseguia produzir engrenagens com a precisão necessária. Naturalmente, essa máquina não possuía um sistema operacional.

Apesar das limitações de hardware, Babbage percebeu a necessidade de software e contratou Ada Lovelace, filha do poeta Lord Byron. Ela é historicamente reconhecida como a primeira programadora do mundo, e a linguagem de programação Ada foi nomeada em sua homenagem.

Primeira geração (1945 - 1955)2.4.1

Após os esforços iniciais de Babbage, o progresso na construção de computadores digitais permaneceu estagnado até a Segunda Guerra Mundial, evento que estimulou uma explosão de atividade no setor. Nesse período, surgiram diversas iniciativas pioneiras, como o trabalho do professor John Atanasoff e seu aluno Clifford Berry na Universidade do Estado de Iowa, que construíram o que hoje é considerado o primeiro computador digital funcional, utilizando 300 válvulas.

Simultaneamente, outros inventores desenvolviam suas próprias máquinas, cada uma com características tecnológicas distintas, conforme detalhado na tabela abaixo:

| Computador | Criadores/Localização | Tecnologia Base |

|---|---|---|

| Atanasoff-Berry | John Atanasoff e Clifford Berry (Iowa) | Válvulas (Primeiro digital funcional). |

| Z3 | Konrad Zuse (Berlim) | Relés eletromagnéticos. |

| Colossus | Grupo incluindo Alan Turing (Bletchley Park) | Válvulas (Programável). |

| Mark I | Howard Aiken (Harvard) | Eletromecânico. |

| ENIAC | William Mauchley e J. Presper Eckert (Pensilvânia) | Válvulas. |

Apesar dos avanços, essas máquinas eram extremamente primitivas, levando segundos para realizar até mesmo os cálculos mais simples. O fluxo de trabalho era totalmente centralizado: um único grupo de engenheiros projetava, construía, programava, operava e mantinha o equipamento. Não existiam linguagens de programação, nem mesmo a linguagem de montagem (Assembly), e o conceito de sistema operacional era desconhecido.

A programação não envolvia digitar código, mas sim conectar circuitos elétricos fisicamente. O programador inseria milhares de cabos em painéis de ligações para controlar as funções básicas da máquina, ou utilizava código de máquina absoluto.

A rotina operacional exigia que o programador reservasse um horário em uma ficha de registro, dirigisse-se à sala de máquinas e inserisse seu painel de programação. O sucesso da operação dependia da sorte, pois era necessário torcer para que nenhuma das cerca de 20.000 válvulas queimasse durante o processo. O uso primordial desses computadores restringia-se a cálculos numéricos e matemáticos diretos, como a criação de tabelas de senos, cossenos, logaritmos e o cálculo de trajetórias de artilharia.

No início da década de 1950, a introdução dos cartões perfurados trouxe uma melhoria significativa ao processo. A partir desse momento, tornou-se possível escrever programas em cartões e lê-los na máquina, eliminando a necessidade dos complexos painéis de ligações manuais, embora o restante do procedimento operacional permanecesse essencialmente o mesmo.

Segunda geração (1955 - 1965)2.4.2

A introdução do transistor em meados dos anos 1950 alterou radicalmente o cenário tecnológico. Os computadores tornaram-se confiáveis a ponto de serem comercializados com a expectativa de funcionamento contínuo, permitindo que, pela primeira vez, houvesse uma clara distinção profissional entre projetistas, construtores, operadores, programadores e equipes de manutenção.

Essas máquinas, conhecidas como computadores de grande porte ou mainframes, ficavam isoladas em salas climatizadas e eram operadas por profissionais especializados. Devido ao alto custo, apenas grandes corporações e instituições governamentais podiam adquiri-las. O fluxo de trabalho era manual e fragmentado: o programador escrevia o código no papel (geralmente em FORTRAN ou Assembly), perfurava os cartões e os entregava a um operador. O computador permanecia ocioso por longos períodos enquanto os operadores caminhavam pela sala transportando maços de cartões e saídas impressas.

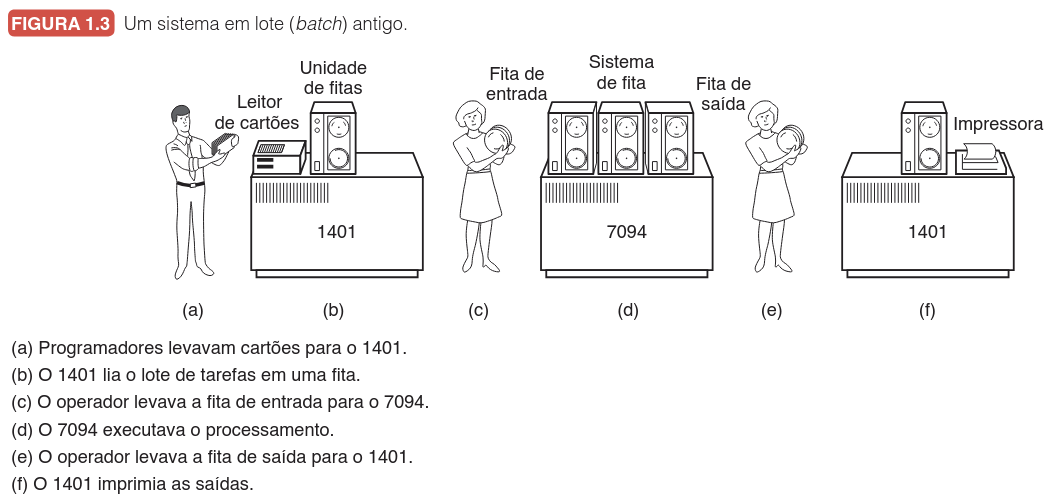

Para solucionar o desperdício de tempo da CPU, foi desenvolvido o conceito de Sistema em Lote (Batch System). A estratégia consistia em utilizar um computador auxiliar mais barato (como o IBM 1401) para realizar a entrada e saída de dados, reservando o computador principal (como o IBM 7094) exclusivamente para o processamento pesado. O fluxo operacional desse sistema é detalhado na figura a seguir:

- Coleta: O IBM 1401 lia um lote de cartões e os gravava em uma fita magnética.

- Processamento: A fita era levada ao IBM 7094, onde um programa antecessor do sistema operacional executava as tarefas sequencialmente, gravando os resultados em uma fita de saída.

- Impressão: A fita de saída retornava ao IBM 1401 para impressão off-line, liberando o processador principal para o próximo lote.

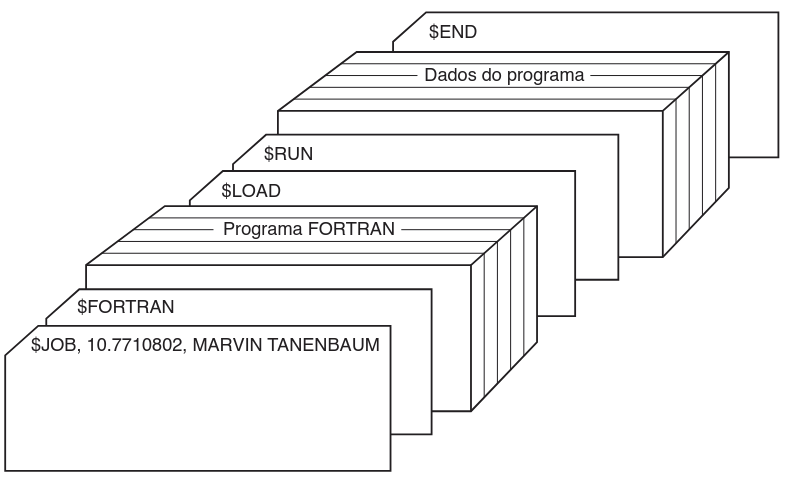

A comunicação entre o programador e esse sistema primitivo era feita através de cartões de controle, que funcionavam como precursores das linguagens de comando modernas. A estrutura de uma tarefa típica pode ser visualizada na figura abaixo:

Cada cartão possuía uma função específica para orientar o sistema operacional sobre como tratar o programa, conforme descrito na tabela a seguir:

| Cartão de Controle | Função no Sistema |

|---|---|

| $JOB | Especifica o início da tarefa, limite de tempo, número da conta e nome do programador. |

| $FORTRAN | Instrui o sistema a carregar o compilador FORTRAN da fita do sistema. |

| $LOAD | Ordena o carregamento do programa-objeto recém-compilado para a memória. |

| $RUN | Comanda a execução do programa utilizando os dados fornecidos na sequência. |

| $END | Marca o término da tarefa e prepara o sistema para o próximo job. |

Esses computadores de segunda geração eram dedicados majoritariamente a cálculos científicos e de engenharia, como a resolução de equações diferenciais. Os sistemas operacionais representativos desse período incluíam o FMS (Fortran Monitor System) e o IBSYS, utilizado no IBM 7094.

Terceira geração (1965 - 1980)2.4.3

No início da década de 1960, o mercado de computação enfrentava um dilema estrutural, com fabricantes mantendo duas linhas de produtos distintas e incompatíveis. De um lado, existiam os computadores científicos de grande escala, como o IBM 7094, focados em cálculos numéricos complexos. Do outro, os computadores comerciais, como o IBM 1401, dedicados à ordenação e impressão de dados para bancos e seguradoras. Essa segregação gerava custos elevados de manutenção e dificultava a escalabilidade para os clientes. A resposta da IBM foi a introdução do System/360, uma família de máquinas baseada em Circuitos Integrados (CIs) que unificava ambas as arquiteturas.

O conceito do System/360 permitia que todos os modelos, desde os mais simples até os mais potentes, executassem o mesmo software, diferenciando-se apenas por preço e desempenho. No entanto, a tentativa de criar um sistema operacional universal, o OS/360, que funcionasse em todas as configurações e atendesse a propósitos tão díspares, resultou em um software de complexidade monstruosa e repleto de erros. Apesar desses desafios, essa geração popularizou técnicas fundamentais que definem a computação moderna, principalmente a multiprogramação.

Na geração anterior, a CPU ficava ociosa enquanto aguardava operações de Entrada/Saída (E/S). A multiprogramação resolveu isso dividindo a memória em partições, permitindo que várias tarefas residissem nela simultaneamente. Quando uma tarefa aguardava E/S, a CPU alternava imediatamente para outra, otimizando o uso do processador.

A figura a seguir ilustra esse conceito de particionamento de memória:

Outra inovação crucial foi o Spooling (Simultaneous Peripheral Operation On Line), que permitia carregar tarefas do cartão para o disco assim que chegavam, eliminando o transporte manual de fitas. Contudo, o sistema ainda operava em lote, o que frustrava programadores devido à demora no feedback. Esse cenário impulsionou o desenvolvimento do Timesharing (compartilhamento de tempo), uma evolução da multiprogramação onde cada usuário possuía um terminal online, permitindo interação em tempo real com o sistema.

O projeto MULTICS, desenvolvido pelo M.I.T., Bell Labs e General Electric, visava criar uma máquina capaz de suportar centenas de usuários simultâneos, funcionando como um serviço de utilidade pública análogo à distribuição de eletricidade. Embora tenha sido um fracasso comercial na época devido à sua complexidade excessiva, o MULTICS introduziu conceitos que hoje fundamentam a computação em nuvem (cloud computing).

O legado do MULTICS foi vital para o surgimento do ecossistema UNIX. Ken Thompson, um dos cientistas do Bell Labs que trabalhou no MULTICS, desenvolveu uma versão simplificada que evoluiu para o UNIX. Devido à disponibilidade do código-fonte, surgiram diversas variantes incompatíveis (como o System V e o BSD), o que levou o IEEE a criar o padrão POSIX para unificar as interfaces de sistema.

A tabela abaixo resume a linhagem evolutiva que conecta os sistemas dessa era ao cenário atual:

| Sistema | Origem/Criador | Impacto e Legado |

|---|---|---|

| MULTICS | MIT, Bell Labs, GE | Pai do conceito de "computação como serviço"; influenciou o UNIX. |

| UNIX | Ken Thompson (Bell Labs) | Sistema modular e portátil; base para servidores modernos e macOS. |

| MINIX | Andrew Tanenbaum | Clone educacional do UNIX; alta confiabilidade e microkernel. |

| Linux | Linus Torvalds | Inspirado no MINIX; tornou-se o sistema open-source dominante mundialmente. |

Quarta geração (1980 - presente)2.4.4

A era moderna da computação foi inaugurada pelo desenvolvimento dos circuitos integrados em larga escala (LSI), chips que contêm milhares de transistores em um único centímetro quadrado de silicone. Embora a arquitetura dos computadores pessoais (inicialmente chamados de microcomputadores) não diferisse drasticamente dos minicomputadores anteriores, como o PDP-11, a redução de custo foi revolucionária. Enquanto os minicomputadores permitiam que departamentos inteiros possuíssem uma máquina, o microprocessador democratizou a tecnologia, tornando possível que indivíduos tivessem seus próprios computadores pessoais.

A história dos sistemas operacionais para esses dispositivos começou em 1974, quando a Intel lançou o 8080, a primeira CPU de 8 bits de uso geral. Gary Kildall, consultor da Intel, desenvolveu o CP/M (Control Program for Microcomputers) para gerenciar o hardware, especificamente o disco flexível. A Intel, não prevendo o futuro dos microcomputadores com disco, cedeu os direitos a Kildall, que fundou a Digital Research. O CP/M dominou o mercado por cerca de cinco anos, sendo adaptado para diversos processadores como o Zilog Z80. Contudo, o cenário mudou drasticamente no início da década de 1980, quando a IBM buscou um sistema operacional para o seu novo PC. Após uma tentativa fracassada de negociação com Kildall, a IBM recorreu a Bill Gates. Gates adquiriu o DOS (Disk Operating System) de uma empresa local, a Seattle Computer Products, contratou seu criador, Tim Paterson, e refinou o sistema para criar o MS-DOS. A estratégia de Gates de vender o MS-DOS empacotado com o hardware, ao contrário da venda direta ao consumidor final tentada por Kildall, foi decisiva para o domínio da Microsoft.

A decisão da IBM de licenciar o software da Microsoft, em vez de desenvolvê-lo internamente ou comprar a exclusividade, permitiu que o MS-DOS se tornasse o padrão de mercado, eclipsando o CP/M. Enquanto o sucessor do IBM PC (o PC/AT com chip Intel 80286) se estabelecia, o CP/M desaparecia.

Inicialmente, tanto o CP/M quanto o MS-DOS baseavam-se inteiramente em interfaces de linha de comando, exigindo que os usuários digitassem instruções textuais. Essa interação mudou graças às pesquisas de Doug Engelbart no Instituto de Pesquisa de Stanford e, posteriormente, na Xerox PARC, onde foi inventada a Interface Gráfica do Usuário (GUI). Steve Jobs, cofundador da Apple, percebeu o potencial dessa tecnologia e a implementou no Macintosh. O sucesso do Macintosh provou que computadores poderiam ser acessíveis a leigos, utilizando janelas, ícones, menus e mouses. A Microsoft, influenciada por esse sucesso, desenvolveu o Windows.

A evolução do Windows e sua competição no mercado podem ser visualizadas através das fases distintas de desenvolvimento da Microsoft, conforme a tabela abaixo:

| Fase / Versão | Características Principais | Base Tecnológica |

|---|---|---|

| Windows Inicial (1.0 - 3.x) | Ambiente gráfico (shell) rodando sobre o MS-DOS. | MS-DOS (16 bits). |

| Windows 95/98/ME | Sistemas híbridos, interface aprimorada, suporte a 32 bits, mas ainda dependentes de código legado. | MS-DOS (para boot) e Assembly 16 bits. |

| Windows NT/2000 | Reescrita completa, sistema robusto de 32 bits, focado em redes corporativas. | Kernel NT (inspirado no VMS). |

| Windows XP | Fusão das linhas doméstica (9x) e corporativa (NT). Alta longevidade. | Kernel NT. |

| Windows Vista/7/8 | Foco em segurança, interface visual (Aero) e, posteriormente, telas de toque (Win 8). | Evolução do Kernel NT. |

Paralelamente ao universo Windows, o UNIX manteve sua relevância, especialmente em servidores e no meio acadêmico. O Linux, um sistema inspirado no MINIX e criado por Linus Torvalds, emergiu como uma alternativa poderosa e de código aberto, rodando na onipresente arquitetura x86. É importante notar que "x86" refere-se à família de arquiteturas de instruções iniciada com o Intel 8086, mantendo compatibilidade retroativa por décadas. Outro derivado importante do UNIX é o FreeBSD, que serve de base para o moderno macOS da Apple. Embora muitos usuários de UNIX prefiram a linha de comando, o sistema X Window (X11) permite a utilização de interfaces gráficas completas, como Gnome ou KDE.

A Computação em Rede e Distribuída representa o desenvolvimento final desta geração. A partir de meados dos anos 80, o crescimento das redes levou à distinção entre dois tipos de sistemas que operam com múltiplos computadores.

A diferença fundamental entre eles reside na transparência para o usuário:

- Sistemas Operacionais de Rede: O usuário está ciente da existência de múltiplas máquinas. Ele precisa realizar logins remotos ou copiar arquivos explicitamente de um servidor para outro. Cada máquina roda seu próprio sistema operacional local e gerencia seus próprios usuários.

- Sistemas Operacionais Distribuídos: O sistema aparece para o usuário como um único computador monoprocessador, embora seja composto por vários processadores. O gerenciamento de onde os arquivos estão armazenados ou onde os programas são executados é feito de forma automática e transparente pelo sistema, exigindo algoritmos complexos de escalonamento e comunicação para lidar com informações que podem estar desatualizadas ou incompletas devido a atrasos na rede.

Quinta geração (1990 - presente)2.4.5

A aspiração humana por dispositivos de comunicação portáteis remonta à ficção, exemplificada pelo "rádio relógio de pulso" do detetive Dick Tracy nos quadrinhos da década de 1940. A materialização desse desejo iniciou-se rudimentarmente em 1946 com o primeiro telefone móvel, um equipamento que pesava cerca de 40 quilos e dependia de um automóvel para ser transportado. Somente na década de 1970 surgiu o primeiro telefone verdadeiramente portátil, carinhosamente apelidado de "o tijolo" devido ao seu peso de aproximadamente um quilo.

Atualmente, com a penetração global da telefonia móvel próxima de 90%, a função original de realizar chamadas tornou-se secundária. Os dispositivos evoluíram para centros de computação pessoal que permitem receber e-mails, navegar na web, enviar mensagens instantâneas e utilizar sistemas de geolocalização. Embora a convergência entre telefonia e computação fosse teorizada desde os anos 1970, o primeiro smartphone propriamente dito surgiu apenas em meados da década de 1990. A Nokia foi pioneira com o modelo N9000, que fundiu fisicamente um telefone e um PDA (Assistente Digital Pessoal), enquanto a Ericsson cunhou o termo smart phone em 1997 com seu modelo GS88 "Penelope".

A onipresença desses dispositivos desencadeou uma competição feroz entre sistemas operacionais, caracterizada por reviravoltas rápidas na liderança de mercado. Inicialmente, o Symbian OS dominava o setor, sendo a escolha de grandes fabricantes como Samsung, Sony Ericsson, Motorola e, especialmente, a Nokia. Contudo, novos competidores como o Blackberry OS da RIM (focado no mercado corporativo) e o iOS da Apple (voltado ao consumidor final) começaram a erodir essa hegemonia. A queda do Symbian foi dramática, culminando no seu abandono pela Nokia em 2011 em favor do Windows Phone.

Embora a Apple e a RIM tenham desfrutado de grande prestígio, o Android rapidamente superou seus rivais. Lançado pelo Google em 2008 e baseado em Linux, o sistema destacou-se por ser aberto e possuir uma licença permissiva. Isso permitiu que fabricantes adaptassem o software ao seu hardware com facilidade, fomentando uma vasta comunidade de desenvolvedores que criam aplicativos majoritariamente na linguagem Java.

A tabela abaixo resume a evolução cronológica e as características dos principais protagonistas dessa era:

| Período/Evento | Sistema/Dispositivo | Impacto e Características |

|---|---|---|

| Anos 90 (Pioneirismo) | Nokia N9000 / Ericsson GS88 | Fusão de hardware (Telefone + PDA). Criação do termo "smartphone". |

| Anos 2000 (Era Pré-Touch) | Symbian OS | Dominância global inicial, usado pela Nokia e Motorola. |

| Nichos Específicos | BlackBerry OS | Foco em e-mail e segurança corporativa. |

| 2007 (Revolução) | iOS (Apple) | Foco na experiência do consumidor e interface de toque. |

| 2008 - Presente | Android (Google) | Sistema aberto, baseado em Linux, dominante por sua flexibilidade e ecossistema. |

Revisão sobre hardware de computadores2.5

Um sistema operacional está intrinsecamente vinculado ao hardware do computador onde é executado. Sua função é estender o conjunto de instruções da máquina e gerenciar seus recursos, o que exige um conhecimento profundo do hardware, especialmente da interface apresentada ao programador. Antes de explorarmos os detalhes funcionais dos sistemas operacionais, é fundamental estabelecer uma base sobre a arquitetura dos computadores pessoais modernos.

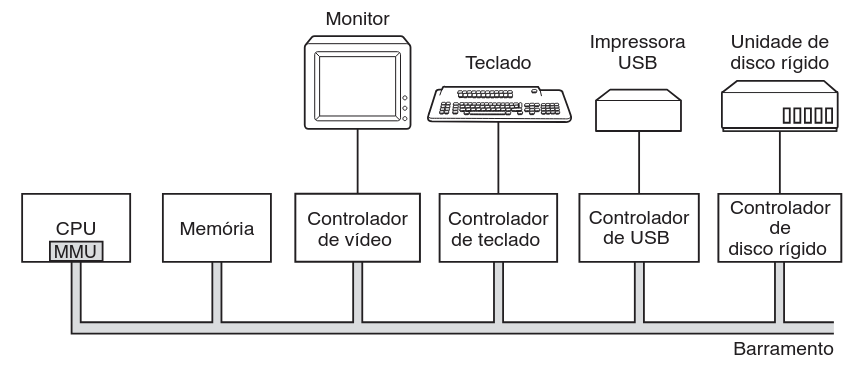

Conceitualmente, é possível abstrair um computador pessoal simples através de um modelo onde a CPU, a memória e os dispositivos de Entrada/Saída (E/S) estão interconectados por um sistema de barramento comum. A figura abaixo ilustra essa organização fundamental:

Nesse modelo, os componentes comunicam-se entre si através do barramento. Embora a arquitetura real de computadores modernos seja mais complexa, envolvendo múltiplos barramentos e hierarquias, essa abstração simplificada é suficiente para a compreensão inicial dos conceitos que serão abordados. As próximas etapas da análise focarão nos componentes específicos e nas questões de hardware que são de interesse direto para os projetistas de sistemas operacionais.

A revisão apresentada aqui é um resumo compacto. Para um estudo aprofundado sobre organização e arquitetura de computadores, recomenda-se a leitura de obras clássicas como as de Tanenbaum e Austin (2012) e Patterson e Hennessy (2013).

Processadores2.5.1

O processador, ou CPU (Central Processing Unit), atua como o "cérebro" do computador, executando um ciclo contínuo de busca, decodificação e execução de instruções armazenadas na memória. Cada família de processadores (como x86 ou ARM) possui um conjunto de instruções específico, o que impede a execução direta de programas de uma arquitetura em outra.

Devido à disparidade de velocidade entre a CPU e a memória principal, os processadores utilizam registradores internos para armazenar variáveis e resultados temporários. Além dos registradores de uso geral, existem registradores especiais cruciais para o funcionamento do sistema:

| Registrador Especial | Função Principal |

|---|---|

| Contador de Programa (PC) | Armazena o endereço da próxima instrução a ser buscada. |

| Ponteiro de Pilha (SP) | Aponta para o topo da pilha atual, gerenciando o contexto de chamadas de rotinas. |

| PSW (Palavra de Estado do Programa) | Contém bits de controle, códigos de condição e define o modo de execução (usuário ou núcleo). |

O sistema operacional deve gerenciar esses registradores meticulosamente, especialmente durante a multiplexação de tempo, salvando e restaurando seus estados ao alternar entre programas.

A maioria das CPUs opera em dois modos: Modo Núcleo (acesso total ao hardware e instruções) e Modo Usuário (acesso restrito). Programas de usuário devem utilizar uma Chamada de Sistema (via instrução TRAP) para solicitar serviços do sistema operacional, alternando controladamente para o modo núcleo. O hardware também gera "armadilhas" para exceções como divisão por zero, transferindo o controle ao SO para tratamento do erro.

Evolução da Arquitetura: Pipeline e Superescalar2.5.1.1

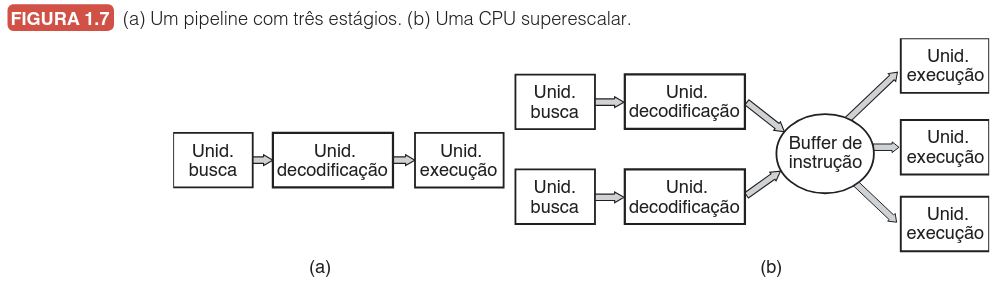

Para superar as limitações do modelo sequencial simples, as CPUs modernas implementam técnicas avançadas de paralelismo:

- Pipeline: Divide a execução da instrução em estágios (busca, decodificação, execução). Enquanto uma instrução é executada, a próxima é decodificada e a seguinte é buscada, aumentando o rendimento.

- Arquitetura Superescalar: Possui múltiplas unidades de execução (aritmética, ponto flutuante, booleana). Permite carregar, decodificar e executar várias instruções simultaneamente, muitas vezes fora de ordem, cabendo ao hardware garantir a consistência do resultado final.

A figura abaixo ilustra a diferença entre essas abordagens:

Multithreading e Multicore2.5.1.2

A Lei de Moore, que prevê a duplicação do número de transistores a cada 18 meses, permitiu o aumento da complexidade dos chips. Para aproveitar essa abundância de transistores, surgiram duas tecnologias principais:

- Multithreading (Hyperthreading): Permite que uma única CPU mantenha o estado de dois threads (fluxos de execução) distintos e alterne entre eles em nanossegundos. Isso otimiza o uso da CPU quando um thread aguarda dados da memória, embora não ofereça paralelismo real de execução simultânea.

- Chips Multinúcleo (Multicore): Integram múltiplos processadores completos (núcleos) em um único chip físico. Cada núcleo possui sua própria CPU independente, permitindo verdadeiro paralelismo. Processadores modernos podem ter de 4 a mais de 60 núcleos.

As GPUs (Unidades de Processamento Gráfico) representam o extremo do paralelismo, contendo milhares de pequenos núcleos. Embora sejam excelentes para tarefas paralelas massivas (como renderização gráfica), são difíceis de programar para tarefas gerais do sistema operacional, que tendem a ser seriais.

A presença de múltiplos threads e núcleos exige que o sistema operacional seja capaz de distinguir e escalonar tarefas eficientemente, evitando, por exemplo, alocar dois threads intensivos na mesma CPU lógica enquanto outros núcleos permanecem ociosos.

Memória2.5.2

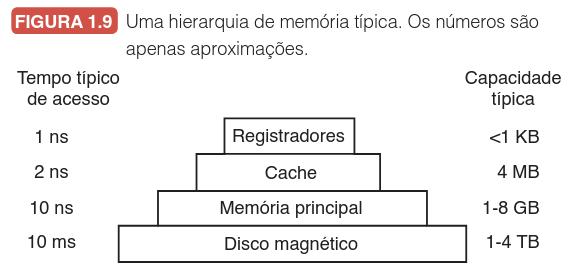

A memória é o segundo componente fundamental de um computador, essencial para o funcionamento do sistema. O ideal teórico seria uma memória extremamente rápida (para não atrasar a CPU), com capacidade infinita e custo irrisório. Como nenhuma tecnologia atual atende simultaneamente a todos esses requisitos, a solução adotada é a construção de uma hierarquia de memória.

Nessa estrutura em camadas, os níveis superiores oferecem maior velocidade, porém com menor capacidade e maior custo por bit. À medida que descemos na hierarquia, a capacidade aumenta e o custo diminui, mas a velocidade de acesso cai drasticamente. A figura a seguir ilustra essa pirâmide:

Níveis da Hierarquia2.5.2.1

. Registradores2.5.2.1.1

Situados no topo da pirâmide, dentro da própria CPU, são feitos do mesmo material ultrarrápido do processador. O acesso é imediato, sem atrasos.

- Capacidade Típica: Menos de 1 KB.

- Gerenciamento: Controlado explicitamente pelo software (compilador/programador).

. Memória Cache (L1, L2, L3)2.5.2.1.2

A memória cache atua como um intermediário de alta velocidade entre a CPU e a memória principal. Ela armazena as linhas de memória (blocos de dados, tipicamente 64 bytes) mais acessadas recentemente.

- Cache Hit: O dado requisitado está na cache. O acesso é muito rápido (aprox. 2 ciclos de CPU).

- Cache Miss: O dado não está na cache. Ocorre uma penalidade de tempo para buscá-lo na memória principal.

O princípio do caching é universal na ciência da computação: armazenar recursos frequentemente usados em um local de acesso rápido. Isso se aplica não apenas ao hardware, mas também ao sistema operacional (ex: manter arquivos lidos recentemente na RAM) e à internet (ex: cache de DNS e páginas web).

CPUs modernas geralmente possuem múltiplos níveis de cache:

- L1 (Nível 1): Interna ao núcleo, dividida em instruções e dados. Acesso sem atraso.

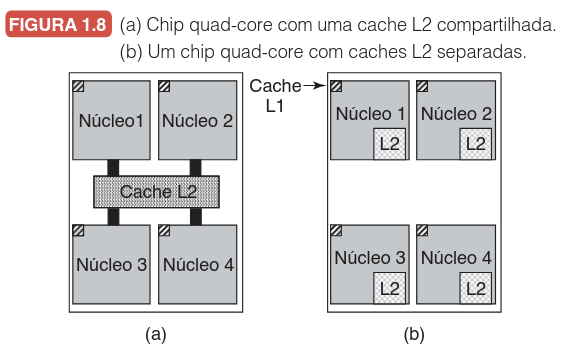

- L2 (Nível 2): Maior e ligeiramente mais lenta. Pode ser exclusiva por núcleo (abordagem comum da AMD) ou compartilhada entre todos os núcleos (abordagem comum da Intel), conforme mostrado na figura abaixo:

. Memória Principal (RAM)2.5.2.1.3

É a "locomotiva" do sistema, onde residem os programas e dados em execução.

- Característica: Volátil (perde dados sem energia).

- Capacidade Típica: De centenas de MB a vários GB.

- Tecnologia: Antigamente chamada de "memória de núcleo" (core memory), hoje baseada em semicondutores.

. Memórias Não Voláteis e Especiais2.5.2.1.4

Além da hierarquia padrão, existem tipos específicos de memória para funções críticas:

| Tipo | Característica | Uso Típico |

|---|---|---|

| ROM (Read Only Memory) | Gravada na fábrica, não modificável, rápida e barata. | Código de inicialização (bootstrap), firmware de baixo nível. |

| EEPROM / Flash | Não volátil, mas apagável e reescrita eletricamente. Mais lenta que a RAM. | Armazenamento em dispositivos móveis (câmeras, pendrives), BIOS atualizável. |

| CMOS | Volátil, mas de baixíssimo consumo, alimentada por bateria. | Relógio de tempo real (data/hora), configurações de BIOS/boot. |

A memória CMOS depende de uma pequena bateria para manter os dados quando o computador está desligado. Quando essa bateria falha após anos de uso, o computador pode apresentar sintomas de "esquecimento", perdendo a data correta ou a configuração de qual disco deve ser usado para iniciar o sistema.

Discos2.5.3

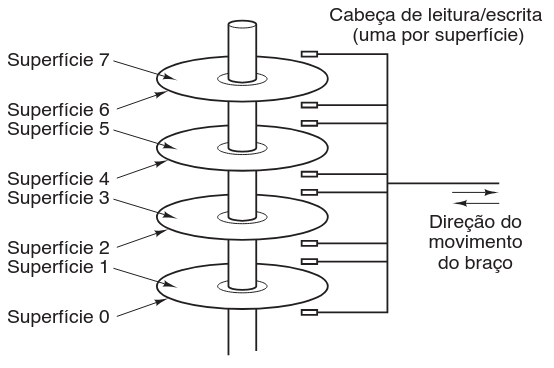

Descendo na hierarquia de armazenamento, encontramos o disco magnético, popularmente conhecido como disco rígido (HDD). Esta tecnologia apresenta uma compensação clara em relação à memória principal: o custo por bit é duas ordens de magnitude menor e a capacidade é frequentemente duas ordens de magnitude maior que a da RAM. Entretanto, o tempo de acesso aleatório aos dados é drasticamente superior, chegando a ser três ordens de magnitude mais lento. Essa latência deve-se à natureza física do dispositivo, que, diferentemente da eletrônica veloz da CPU, opera através de mecanismos mecânicos.

A estrutura de um disco rígido convencional consiste em um ou mais pratos metálicos que giram em altas velocidades, tipicamente entre 5.400 e 10.800 RPM. Um braço mecânico move-se sobre a superfície desses pratos, operando de maneira análoga ao braço de um antigo toca-discos de vinil. A organização lógica dos dados ocorre em círculos concêntricos denominados trilhas. O conjunto vertical de todas as trilhas alinhadas em uma mesma posição do braço, considerando todos os pratos empilhados, forma um cilindro.

A figura a seguir ilustra a complexidade mecânica desse dispositivo:

O desempenho de leitura e escrita é limitado por fatores físicos. Cada trilha é dividida em setores, geralmente de 512 bytes. Para acessar um dado, o sistema enfrenta dois tipos principais de atraso mecânico. Primeiro, o braço deve mover-se até o cilindro correto; esse movimento pode levar de 1 ms (cilindros adjacentes) a 10 ms (acesso aleatório). Segundo, após o braço estacionar, é necessário aguardar que o setor desejado gire até posicionar-se sob a cabeça de leitura. Uma vez posicionado, a taxa de transferência de dados varia de 50 MB/s a 160 MB/s, dependendo da qualidade do disco.

| Componente de Atraso | Descrição | Tempo Típico |

|---|---|---|

| Tempo de Busca (Seek) | Movimento do braço até o cilindro correto. | 5 a 10 ms (aleatório). |

| Latência Rotacional | Espera para o setor girar até a cabeça. | 5 a 10 ms (depende da RPM). |

| Transferência | Leitura ou escrita efetiva dos dados. | 50 a 160 MB/s. |

É importante distinguir os discos rígidos tradicionais dos modernos SSDs (Solid State Disks). Embora cumpram a mesma função de armazenamento persistente e não volátil, os SSDs não possuem partes móveis, pratos ou braços mecânicos. Eles armazenam dados em memória flash, eliminando a latência mecânica e aproximando-se mais da arquitetura de memória do que da de discos tradicionais.

A existência de armazenamento em disco abundante permite o uso de Memória Virtual. Esse esquema possibilita a execução de programas maiores que a memória física (RAM) disponível, utilizando o disco como uma extensão da memória principal. O sistema mantém na RAM apenas as partes do programa em execução ativa, comportando-se como uma cache.

Para viabilizar a memória virtual, o sistema precisa converter rapidamente os endereços virtuais gerados pelo programa em endereços físicos na RAM. Essa tradução crítica é realizada por um componente de hardware específico da CPU chamado MMU (Memory Management Unit).

A interação entre a cache, a MMU e o sistema operacional é decisiva para o desempenho global. Em ambientes de multiprogramação, ocorre frequentemente o chaveamento de contexto, que é a alternância da CPU de um programa para outro. Durante esse processo, pode ser necessário limpar os blocos modificados da cache e atualizar os registros de mapeamento da MMU. Como ambas são operações computacionalmente caras, os arquitetos de software e hardware empregam diversas táticas para minimizar sua frequência e impacto.

Dispositivos de E/S2.5.4

Além da CPU e da memória, o sistema operacional enfrenta o desafio crítico de gerenciar os dispositivos de Entrada e Saída (E/S). Conforme visualizado anteriormente na arquitetura do computador, esses componentes são geralmente divididos em duas partes distintas: o controlador e o dispositivo propriamente dito. O controlador, constituído por um chip ou conjunto de chips, é responsável pelo controle físico do hardware. Ele atua como um intermediário complexo que recebe comandos de alto nível do sistema operacional e os converte em operações físicas detalhadas. Por exemplo, ao solicitar a leitura de um setor específico em um disco, o controlador deve realizar cálculos geométricos complexos, converter números de setores lineares em coordenadas de cilindro, cabeça e setor, gerenciar setores defeituosos e verificar somas de verificação (checksum) dos dados lidos.

Para viabilizar a comunicação entre o sistema operacional e a vasta gama de controladores existentes, utiliza-se o conceito de Driver de Dispositivo. Como cada controlador possui especificidades únicas, os fabricantes fornecem esses softwares para traduzir os comandos genéricos do sistema operacional em instruções que o hardware específico compreenda.

O driver de dispositivo é o software que conversa diretamente com o controlador, enviando comandos e recebendo respostas. Ele atua como um tradutor, permitindo que o sistema operacional interaja com hardwares diversos (como discos SATA ou digitalizadores) através de uma interface padronizada, independentemente da complexidade interna do dispositivo.

A instalação e o carregamento desses drivers no sistema operacional podem ocorrer de três formas distintas, refletindo a evolução dos sistemas computacionais:

| Método de Instalação | Descrição e Uso Típico |

|---|---|

| Religação do Núcleo | O núcleo é recompilado com o novo driver e o sistema é reinicializado. Comum em sistemas UNIX antigos. |

| Arquivo de Configuração | O sistema lê uma lista de drivers necessários em um arquivo durante a inicialização e os carrega. Método utilizado pelo Windows. |

| Carregamento Dinâmico (Hot-plug) | O sistema aceita e instala drivers em tempo de execução, sem reiniciar. Essencial para dispositivos USB e IEEE 1394. |

Para que o driver se comunique com o controlador, ele utiliza um conjunto de registradores presentes no hardware. O sistema operacional escreve comandos nesses registradores para ativar o dispositivo. Existem duas arquiteturas principais para acessar esses registradores: o espaço de portas de E/S, onde instruções especiais (como IN e OUT) são usadas para acessar endereços específicos de porta, e a E/S mapeada em memória, onde os registradores são acessados como se fossem endereços de memória RAM comuns, permitindo proteção via hardware de gerenciamento de memória.

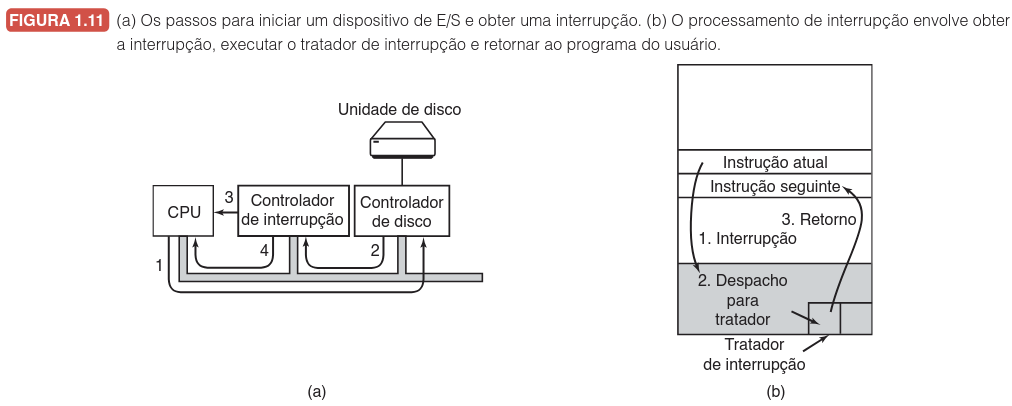

A execução das operações de E/S pode ser realizada através de três estratégias. A mais simples, chamada de espera ocupada, mantém a CPU presa em um laço de repetição verificando continuamente se o dispositivo terminou a tarefa, o que desperdiça ciclos de processamento. A segunda e mais eficiente estratégia utiliza interrupções, permitindo que a CPU realize outras tarefas enquanto o dispositivo trabalha. A terceira, conhecida como DMA (Acesso Direto à Memória), utiliza um chip especial para controlar o fluxo de dados entre a memória e o dispositivo sem intervenção constante da CPU.

O mecanismo de interrupção é fundamental para o desempenho do sistema. O processo ocorre em etapas bem definidas, conforme ilustrado abaixo:

No processo de interrupção, o driver inicia o dispositivo e a CPU fica livre. Quando o controlador termina a operação, ele envia um sinal ao controlador de interrupção. Se a CPU estiver apta a receber, o processamento atual é suspenso, o estado do processador (Contador de Programa e PSW) é salvo na pilha, e o controle é desviado para uma rotina especial chamada tratador de interrupção. O endereço dessa rotina é geralmente localizado através de um vetor de interrupção na memória. Após o tratador finalizar o serviço do dispositivo, o estado anterior da CPU é restaurado, e o programa interrompido continua sua execução exatamente de onde parou. Para gerenciar múltiplas solicitações simultâneas, o controlador de interrupção utiliza prioridades estáticas, garantindo que dispositivos críticos sejam atendidos primeiro.

Barramentos2.5.5

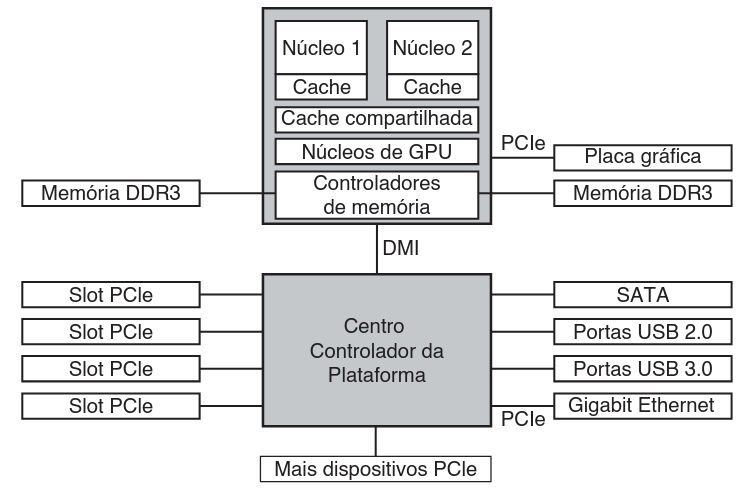

A arquitetura simplificada de barramento único, que serviu aos primeiros microcomputadores e ao PC IBM original, tornou-se obsoleta com o aumento vertiginoso da velocidade dos processadores e memórias. O tráfego intenso gerado por componentes modernos exigiu uma evolução para sistemas complexos com múltiplos barramentos especializados, cada um otimizado para uma função e taxa de transferência específicas.

Atualmente, um sistema x86 robusto assemelha-se à estrutura apresentada na figura abaixo, integrando diversos padrões de comunicação:

O sistema operacional deve gerenciar essa complexa teia de interconexões, que inclui:

- DDR3/DDR4: Barramento de altíssima velocidade exclusivo para comunicação entre CPU e Memória Principal.

- PCIe (Peripheral Component Interconnect Express): Sucessor do PCI e do ISA, é o barramento principal para periféricos de alto desempenho. Diferente de seus antecessores que usavam arquitetura paralela e compartilhada (onde dispositivos disputavam o mesmo canal), o PCIe utiliza conexões seriais dedicadas ponto a ponto. Ele organiza os dados em pacotes e utiliza múltiplas "faixas" (lanes) para escalar a velocidade, podendo transferir dezenas de gigabits por segundo.

- DMI (Direct Media Interface): Conecta a CPU ao centro controlador da plataforma (o chipset), que por sua vez gerencia os periféricos mais lentos.

- USB (Universal Serial Bus): Originalmente criado para dispositivos lentos (teclado, mouse), evoluiu drasticamente. O USB 3.0, por exemplo, atinge 5 Gbps. É um barramento centralizado onde o controlador raiz interroga os dispositivos a cada milissegundo. Sua grande vantagem é permitir a conexão a quente (hot-plug).

- SATA: Dedicado à conexão de dispositivos de armazenamento massivo, como discos rígidos e SSDs.

- SCSI: Barramento de alto desempenho, comum em servidores, atingindo até 640 MB/s.

O padrão PCIe é atualizado a cada 3-5 anos, dobrando sua velocidade a cada nova versão. Por exemplo, 16 faixas de PCIe 2.0 oferecem 64 Gbps, enquanto o PCIe 3.0 dobra essa capacidade e o 4.0 a quadruplica.

O Desafio da Configuração e o Plug and Play2.5.5.1

Antigamente, a configuração de hardware era um pesadelo manual. Cada placa de expansão exigia endereços de E/S e níveis de interrupção (IRQ) fixos. Se um usuário instalasse uma placa de som e um modem que, por padrão, tentassem usar a mesma interrupção (ex: IRQ 4), ocorria um conflito de hardware e o sistema falhava. A solução envolvia configurar fisicamente jumpers ou chaves DIP nas placas, uma tarefa propensa a erros e inacessível para o usuário comum.

Para resolver isso, a Intel e a Microsoft, inspiradas pelo Apple Macintosh, desenvolveram o padrão Plug and Play. Nesse sistema, o computador coleta automaticamente informações sobre os dispositivos conectados, atribui recursos (interrupções e endereços) de forma centralizada e configura as placas via software, eliminando a necessidade de intervenção física do usuário e prevenindo conflitos.

Inicializando o computador2.5.6

A inicialização de um computador é uma sequência orquestrada de eventos que começa no hardware e termina com o sistema operacional pronto para o uso. Todo o processo gira em torno da placa-mãe (ironicamente referida no texto original como parentboard), onde reside um software fundamental chamado BIOS (Basic Input Output System). Este sistema, armazenado atualmente em memória Flash RAM não volátil (passível de atualizações), contém as rotinas de baixo nível necessárias para ler o teclado, escrever na tela e realizar a entrada e saída nos discos.

Ao ligar a máquina, o BIOS assume o controle imediato. Sua primeira tarefa é executar uma verificação de hardware, conferindo a quantidade de RAM instalada e se dispositivos essenciais, como o teclado, estão respondendo. Em seguida, ele varre os barramentos PCIe e PCI para detectar e configurar quaisquer novos dispositivos conectados desde a última inicialização.

Após a verificação física, o BIOS consulta a memória CMOS para determinar a ordem dos dispositivos de inicialização (boot sequence). Geralmente, o sistema tenta ler primeiro unidades removíveis (como USB ou CD-ROM) e, caso falhe, recorre ao disco rígido. O primeiro setor do dispositivo escolhido é carregado na memória e executado. Este setor contém um programa que analisa a tabela de partições para identificar a partição ativa e carregar seu gerenciador de inicialização secundário, que por sua vez carrega o sistema operacional.

É importante notar que o BIOS apenas dá o pontapé inicial. Após carregar o núcleo do sistema operacional, ele "passa o bastão". O sistema operacional então consulta o BIOS para obter a configuração do hardware, verifica a existência de drivers para cada dispositivo (solicitando instalação caso faltem), inicializa suas tabelas internas e processos de segundo plano, culminando finalmente na apresentação da tela de login ou interface gráfica (GUI).

Para facilitar a compreensão, a tabela a seguir resume as etapas cruciais desse processo:

| Etapa | Responsável | Ação Principal |

|---|---|---|

| 1. POST | BIOS | Verificação de RAM, teclado e varredura de barramentos. |

| 2. Seleção de Boot | BIOS | Consulta a CMOS e escolhe o dispositivo de inicialização. |

| 3. Carregamento | MBR/Bootloader | Lê o setor de inicialização e carrega o núcleo do SO na memória. |

| 4. Configuração do SO | Sistema Operacional | Carrega drivers, inicializa tabelas e processos de fundo. |

| 5. Interface | Sistema Operacional | Exibe o login ou GUI para o usuário. |

Questões2.6

1. Sobre a localização e função do Sistema Operacional (SO), assinale a alternativa correta:

- A) O SO atua como uma camada interposta entre o hardware e os programas aplicativos, abstraindo a complexidade do sistema.

- B) O SO opera em Modo Usuário, garantindo que não haja interferência direta nos componentes eletrônicos.

- C) O SO é composto principalmente pelo Shell e pela GUI, que interagem diretamente com o hardware.

- D) A principal função do SO é eliminar a necessidade de memória RAM, gerenciando tudo via disco rígido.

2. No contexto de gerenciamento de dispositivos de E/S, o que é o "Spooling" mencionado na Terceira Geração?

- A) Uma técnica para dividir a memória em partições fixas.

- B) O processo de carregar tarefas de cartões para o disco assim que chegam, evitando o transporte manual de fitas.

- C) Um tipo de barramento serial usado para conectar impressoras.

- D) A alternância de threads em uma CPU multicore.

3. Sobre a hierarquia de memória, qual é a principal função da Memória Cache (L1, L2)?

- A) Armazenar o BIOS e as configurações de inicialização permanentemente.

- B) Substituir o disco rígido para armazenamento de arquivos grandes.

- C) Atuar como intermediário de alta velocidade entre a CPU e a RAM, armazenando dados acessados recentemente.

- D) Converter endereços virtuais em endereços físicos através da MMU.

4. Qual a diferença fundamental entre um Sistema Operacional de Rede e um Sistema Operacional Distribuído?

- A) No Sistema Distribuído, o usuário vê múltiplas máquinas como um único processador; no de Rede, o usuário está ciente das múltiplas máquinas.

- B) Sistemas de Rede não usam placas de interface, enquanto Distribuídos usam.

- C) Sistemas Distribuídos são usados apenas em smartphones, enquanto os de Rede são para Mainframes.

- D) Não há diferença, são sinônimos criados na Quarta Geração.

5. Relacione a Coluna A (Conceitos/Tecnologias) com a Coluna B (Definições/Características).

| Coluna A | Coluna B |

|---|---|

| (1) Modo Núcleo | ( ) Técnica onde o recurso é dividido fisicamente, permitindo uso simultâneo por múltiplos clientes. |

| (2) Multiplexação no Tempo | ( ) Software que traduz comandos genéricos do SO em instruções específicas para o controlador do dispositivo. |

| (3) Multiplexação no Espaço | ( ) Nível de privilégio exclusivo do SO com acesso irrestrito ao hardware. |

| (4) Driver de Dispositivo | ( ) Revezamento sequencial do uso de um recurso (ex: CPU) entre diferentes programas. |

| (5) Plug and Play | ( ) Sistema que coleta automaticamente informações de hardware e atribui recursos para evitar conflitos. |

6. Classifique as afirmações abaixo como Verdadeiras (V) ou Falsas (F) de acordo com o texto.

- ( ) A interface gráfica (GUI) e a linha de comando (Shell) são partes integrantes e inseparáveis do núcleo (kernel) do sistema operacional.

- ( ) Em um disco magnético, o tempo de busca (seek) refere-se ao tempo que o setor leva para girar até chegar sob a cabeça de leitura.

- ( ) A multiprogramação surgiu na terceira geração para resolver o problema da ociosidade da CPU enquanto tarefas aguardavam operações de E/S.

- ( ) O BIOS é responsável por carregar o sistema operacional inteiro para a memória RAM e mantê-lo em execução.

- ( ) A tecnologia Hyperthreading permite que uma única CPU execute fisicamente duas instruções ao mesmo tempo, dobrando a capacidade de processamento real.

7. Coloque os eventos abaixo na ordem cronológica correta que ocorre durante a inicialização (boot) de um computador.

- A. O carregador de inicialização (bootloader) lê o sistema operacional da partição ativa e o inicia.

- B. O BIOS verifica a quantidade de RAM e se o teclado está respondendo.

- C. O Sistema Operacional consulta o BIOS para obter a configuração de hardware e carregar os drivers.

- D. O BIOS varre os barramentos PCIe/PCI para detectar novos dispositivos.

- E. O BIOS consulta a memória CMOS para determinar a ordem dos dispositivos de boot e lê o primeiro setor do dispositivo escolhido.

8. A "Estética da Abstração". O texto menciona que o hardware é "feio" e o sistema operacional o torna "belo". Com base no exemplo do disco rígido e arquivos, explique o que essa metáfora significa do ponto de vista do programador.

9. Gerenciamento de E/S e Interrupções. Analise a figura do processo de interrupção. Por que o método de E/S utilizando interrupções é considerado mais eficiente do que o método de espera ocupada (busy wait)? Descreva o papel do "Tratador de Interrupção" nesse processo.

10. Arquitetura de Barramentos. Explique a diferença arquitetural fundamental entre o antigo barramento PCI e o moderno PCIe (PCI Express). Por que o PCIe é atualizado frequentemente (ex: 2.0, 3.0, 4.0)?

11. O Dilema do Cache. Considere a hierarquia de memória. Se a memória Cache (L1/L2) é tão rápida (cerca de 2 ciclos de CPU), por que não construímos computadores inteiros usando apenas esse tipo de memória, eliminando a RAM e o Disco?

Próximos Passos2.7

No próximo capítulo, Conceitos e Estruturas de Sistemas Operacionais, exploraremos a diversidade e a arquitetura interna dos sistemas. Veremos o "Zoológico dos Sistemas Operacionais", entendendo como o software se adapta desde mainframes até sensores e cartões inteligentes. Além disso, definiremos as abstrações fundamentais (como processos, arquivos e chamadas de sistema) e analisaremos como esses componentes são organizados arquiteturalmente em modelos monolíticos, micronúcleos e máquinas virtuais.